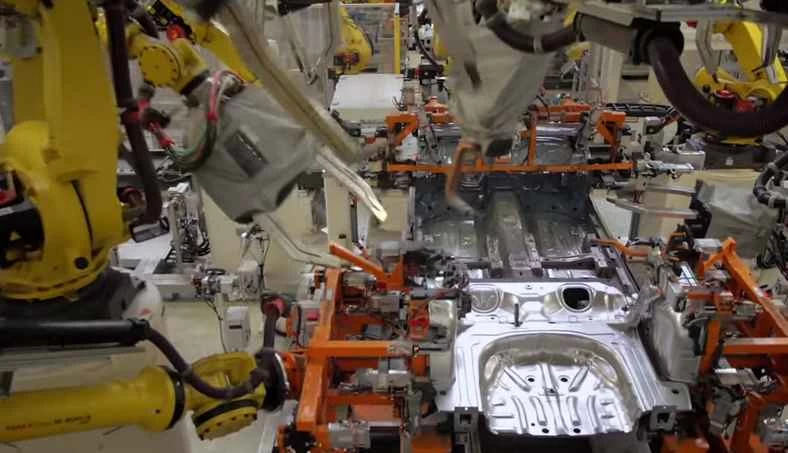

昨日、ドイツでロボットが人を殺したというニュースがインターネット上で大きく報道されました。センセーショナルな報道の裏には、悲劇的な真実がありました。ドイツのフォルクスワーゲン工場で産業用ロボットが、設置作業中の22歳の作業員を実際に殺したのです。報道はさておき、これは機械が引き起こす終末の始まりとは思えませんでした。自宅の裏庭のシェルターに向かう前に、別の意見も聞きたかったのです。ライアン・カロはワシントン大学の法学教授で、ロボットが未来を担う未来、そしてロボットとサイバー法の相互作用に関する論文を発表しています。

Caloさんにいくつか質問をメールで送ったので、以下にそれらと彼の回答をまとめました。また、適切な場所にリンクも追加しました。

ポピュラーサイエンス:昨日、Twitterでは産業用ロボットによる死亡事故が話題になっていました。あなたは当時、「これは比較的よくあることだ」とおっしゃっていましたが、どういう意味だったのでしょうか?

ライアン・カロ:米国だけでも、産業用ロボットによって年間約1人が死亡しています。労働省は、こうした事例を「ロボットに押しつぶされて従業員が死亡」(2006年)や「産業用ロボットによって従業員が死亡」(2004年)といったタイトルで記録しています。

自律型マシン特有のエラーの可能性について、以前も記事を書かれていましたね。今後「ロボットが人を殺した」という話が出てくる際には、「産業事故」から「自律性におけるエラー」へと移行する要因として、どのような点に注意すべきでしょうか?

そうですね。産業用ロボットは、掴んだり移動したりするなど、同じ動作を何度も繰り返す傾向があり、通常、何を扱っているのかを判断できません。そのため、工場ではロボットが動作している間は人が立ち入らなければならない「危険」ゾーンや「キルゾーン」を設けています。私は、将来のロボットが自律性ではなく、創発的な行動を示すという見通しについて書いています。スティーブン・ジョンソンが彼の素晴らしい著書で定義しているように、創発的な行動とは、有用でありながらも予想外の行動を指します。時には、プログラマーを震え上がらせるような、全く予想外のことが起こることもあります。例えば、Googleの画像アルゴリズムは最近、2人の有色人種の写真を「ゴリラ」とタグ付けしました。Googleはまさに愕然としました。

創発的な行動を示す物理的なロボットが登場し始めたら何が起こるかについてお話しします。そこでは事故の種類が異なり、被害者側の過失が関与する可能性は低くなりますが、Googleのタグ付けアルゴリズムほど予測可能ではないかもしれません。

当初の報道では、死因は人為的ミスとされています。自律システムに人間を介入させることは、安全機能ではなく、むしろリスクとなるとお考えですか?

産業用ロボットにおいては、そのような状況はとうの昔に過ぎ去っています。人間を介入させながら、今日の生産性を維持することは不可能です。むしろ、プロトコルや警告などを用いて、人間がロボットの邪魔にならないようにする必要があります。

ロボットによる殺人を防ぐために人間を「制御下に置く」という議論は、自律型兵器に関する議論において当然ながら大きな部分を占める。人間が「意味のある人間的制御」を維持するという点については広く合意されているが、それが何を意味するのかという点についてはほとんど認識されていない。

機械が関与する事故は、自動車事故のように、日常生活の一部として受け入れるべきでしょうか?それとも、「ロボットが人を殺した」という誇張された見出しには、何か警告となるような効果があるのでしょうか?

ロボットへの恐怖が、人命の損失につながるのではないかと、時々心配になります。例えば、自動運転車が食料品カートにぶつかるか、ベビーカーにぶつかるかの選択を迫られるという話をします。自動運転車は人間の運転手より20倍安全だとしましょう。しかし、もし私のシナリオで誤った選択をしたら、「ロボットが食料品を守るために赤ちゃんを殺した」という見出しがつき、自動運転は10年遅れてしまいます。

わかりました。でも、機械が全てを支配する前に、あなた自身が私たちを偽りの安全感に誘い込もうとするロボットでないと、どうしてわかるのですか?

残念ですが、それには答えられません、ケルシー。