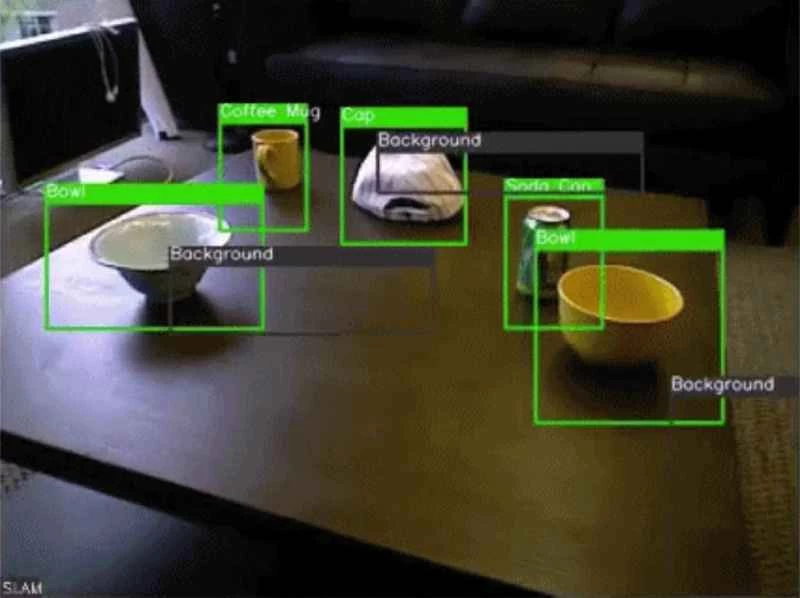

上の GIF に見覚えがあると思ったら、それはおそらく次のものと不気味なほど似ているからでしょう:

もちろん、これは『ターミネーター2』で未来から到着したT-800ターミネーターが世界の物体をこのように見て認識する方法です。

映画と同様に、MITコンピュータサイエンス・人工知能研究所の研究者たちは、通常のRGBカメラ(恐ろしい血のように赤いカラーフィルターは不要)を使って物体を正確に識別できる物体認識システムを開発しました。このシステムは、将来のロボットが複雑な世界を移動する際に、物体とより効率的にインタラクションするのに役立つ可能性があります。

「理想としては、将来的にはロボットが食器を洗ってくれるようになることを願っています。ロボットが実際に対象物を認識し、操作できる認識システムが必要です」と、本研究の筆頭著者であるスディープ・ピライ氏は述べています。

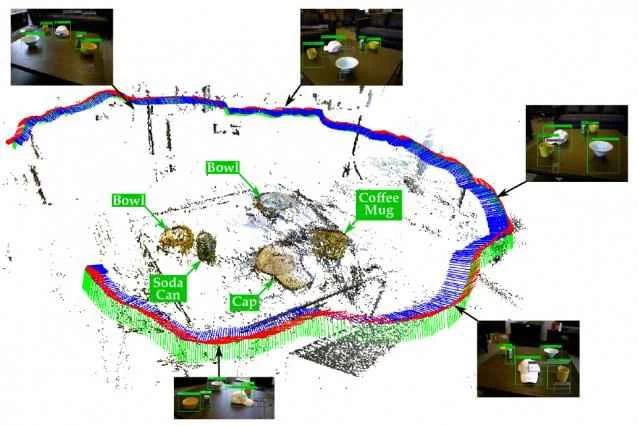

このシステムは、従来の認識システムに加え、「同時自己位置推定・地図作成」(SLAM)と呼ばれるシステムも基盤としています。SLAMは、自律走行車やロボットなどのデバイスに3次元空間認識機能を提供します。研究チームの新しい「SLAM対応」システムは、複数の視点から物体の情報を収集しながら、周囲の環境を地図上に描き出します。角度を変えるたびに、プログラムは物体をより基本的な構成要素に分解することで、その物体が何であるかを予測します。そして、この生成された記述を、既存の物体記述データベースと比較します。例えば、SLAM対応システムが椅子を認識すれば、座面、4本の脚、そして背もたれに分解するかもしれません。

SLAM対応システムは、撮影した物体の3次元マップを作成するため、物体同士をより正確に区別することができます。新たな視点を得るたびに、各物体に関する記述情報が追加されます。このシステムにより、曖昧さが低減され、物体を正しく分類し、ある物体と他の物体を区別する可能性が高まります。

SLAM-awareシステムは、研究チームが「SLAM-oblivious」と呼ぶ従来の画像認識システムとは異なります。従来の画像認識システムは3次元マップを作成せず、一度に1フレームの静止画像からしか物体を検出できないためです。比較すると、SLAM-obliviousシステムは、SLAM-awareシステムよりも、雑然とした環境下で複数の物体を認識するのがはるかに困難です。下のGIF画像では、誤った予測が赤く点滅しています。

ある実験では、SLAM対応システムは86.1%の精度で物体のシーンを正しく識別できました。これは、赤外線による深度情報を考慮できる高度な専用システムに匹敵します。これらの専用システムは92.8%という非常に高い精度を実現できますが、その分時間がかかります。これらのシステムの中には実行時間が約4秒かかるものもありましたが、SLAM対応システムでは1.6秒でした。赤外線を使用するシステムは、照明条件が厳しいため、屋外での動作が困難な場合もあります。

「ロボット工学の観点から言えば、屋外で使用できないというのは、ある意味非現実的です。なぜなら、こうしたシステムは屋内でも屋外でも動作することが求められるからです」とピライ氏は言う。

将来的には、ピライ氏と彼のチームは、このシステムを基に、「ループ閉鎖」と呼ばれるロボット工学における古典的な課題も解決したいと考えています。これは、ロボットが以前いた場所を認識できない状態であり、これは移動や世界とのインタラクションにおいて重要です。SLAM対応システムは、ロボットが様々な場所にある特定の物体を認識し、その場所にとってより重要なものとして分類できるようにすることで、この問題を解決し始める可能性があります。

研究者らは今月、イタリアのローマで開催されたロボット科学システム会議で研究結果を発表した。

「私たちは競合する認識システムと競争したいのではなく、それらをうまく統合できるようにしたいのです」とピライ氏は言う。

SLAM 対応システムによってジョン・コナーの位置特定と保護が容易になるかどうかについては言及されていない。