頭の中で「この崖から飛び降りるのはよくないかもしれない」とか「牛乳を1ガロン全部飲めないよ」などと言う小さな声が聞こえたことがあるでしょう。

そのざわめきは自己不信であり、その存在が私たちの生存を支えています。しかし、ロボットにはこの本能はありません。DARPAロボティクスチャレンジを見れば明らかです。しかし、ロボットやドローンが現実世界で生き残るためには、自らの限界を認識する必要があります。暗闇の中をもがき苦しんだり、壁を突き破ろうとしたりするロボットは許されません。カーネギーメロン大学の研究者たちは、新たな論文の中で、ロボットに内省、つまり自己不信の感覚を与える研究を進めています。人工知能によって自身の失敗の可能性を予測することで、ロボットはより思慮深く、より安全な行動をとることができるようになるかもしれません。

ある行動が失敗するかどうかを判断する鍵は予測です。人間は、ある決定を下した後に起こり得るあらゆる問題を想像することで、自然に結果を予測します。ドローンの飛行経路を決定する場合、アルゴリズムはドローンのカメラから送られてくる映像を確認し、画像に映っている物体に基づいて、次の行動が墜落につながるかどうかを予測する必要があります。ドローンは未来を想像する必要があるのです。

このアイデアは、現在一部のドローンに搭載されている物体検知機能の域を超えています。物体検知は単純なもので、何かが邪魔をしているならそこへは行かないというものです。しかし、このフレームワークにより、AIは状況が本来の任務に悪影響を与えるかどうかを実際に判断できるようになります。これには、ドローンのセンサーを遮る気象条件や、カメラに必要な光量の不足などが含まれます。潜在的な脅威に反応するのではなく、理解するのです。

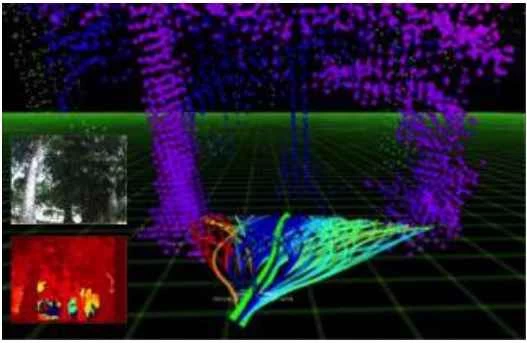

カーネギーメロン大学の実験では、研究者たちは改造したドローンを公園の木々の間を自律飛行させました。ドローンの軌道と、そのコースを取った場合の墜落確率を予測することで、ドローンはイントロスペクションを行わなかった場合の2倍以上の距離、つまり障害物をすり抜けながら1000メートル以上飛行しました。

しかし、この研究はまだ初期段階であり、単独のものではありません。マイクロソフトリサーチのエリック・ホーヴィッツは長年このアイデアに取り組んでおり、複数の意思決定アルゴリズムを連携させることに重点を置いています。

「私たちは、一度に多くの事柄について考察し、一緒に考え、多くの能力と機能を巧みに調整して、よく練習された交響曲のように機能する能動的なシステムを開発しています」とホルヴィッツ氏は語った。

シナリオの一つは、ゲーム番組を再現したもので、AI司会者と2人の人間の出場者が出演していました。AIが質問を投げかけ、人間が答えます。しかし、適切な会話を維持するために、例えば出場者にもっと時間が必要かどうかを尋ねるなど、AIは返答にどれくらいの時間がかかるかを計算し、それを人間が話すまでの予想時間と照合します。もし時間がかかりすぎる場合は、ロボットは沈黙します。

「そのレイヤーを追加するのは素晴らしかった。システムがさらにエレガントになった」とホルヴィッツ氏は語った。

ロボットに自己認識を与える道があるとすれば、それは内省を教えることだ。それは生き残るための生々しい義務感を植え付けることになるが、これは未来学者を震え上がらせるかもしれない考えだ。しかし、少なくとも今のところ、これらのロボットは木を避けるのがやっとなので、少なくともあと数年は人間にとって安全な環境だろう。