1世紀以上前、一般向けカメラが登場して以来、人々は写真の加工を行ってきました。そのため、懐疑的な人々は、同じくらいの期間、そうした加工を見抜き、詐欺を暴こうとしてきました。編集ツールが進歩するにつれて、不正な編集を見抜く方法は、少なくとも法執行機関や画像鑑識といった分野を除けば、遅れをとっています。

Adobeの偽造品検出ツールには、人工知能を活用した複数のツールが含まれています。最近、同社はカリフォルニア大学バークレー校と共同で、Photoshopに組み込まれた「Face Aware Liquify」という機能を用いて顔に加えられた変更を検出する研究を発表しました。写真にソフトウェアを当ててその真正性について確実な答えが得られるようになるまでには、まだ長い道のりがありますが、ディープフェイクと呼ばれる、本物らしくも偽造された動画がますます増える中で、このようなプロジェクトは不可欠となるかもしれません。

どのような操作について話しているのでしょうか?

AdobeがAIベースの画像認証に取り組むのは今回が初めてではありません。実際、同社は既に、画像のつなぎ合わせ、写真からのオブジェクトの削除、画像の一部をコピー&ペーストするといった、より一般的な画像編集技術に焦点を当てた技術に関するデータを公開しています。これらはすべて、よく知られた偽造手法です。

しかし、こうした手法は通常、人間の編集者によって考案されます。編集者は画像や完成品を見ることはできますが、自分の作品に関する痕跡が残されていることに気づかない場合があります。例えば、ある要素をある場所から別の場所にコピー&ペーストすると、デジタルカメラのセンサーによって生成されるデジタルノイズのパターンが乱れることがあります。

しかし、新たな研究では、そもそも AI に依存した編集をリバースエンジニアリングすることを目的とした手法の概要が説明されています。

顔をゆがめる

Photoshopの「ゆがみ」ツールは、何世代にもわたって利用されてきました。画像をゆがめると、ピクセルを上下左右に動かすことができます。モデルの体の特定の部分を(良くも悪くも)太く見せたり細く見せたりすることが簡単にできるため、レタッチ担当者によく使われるツールです。しかし、数バージョン前にAdobeは「顔認識ゆがみ」を発表しました。これはAIを使って顔の個々の要素を認識し、レタッチ担当者が目、鼻、口の大きさや形などの要素を簡単に操作できる機能です。

Face Aware Liquify を使用すると、スライダーを最大まで上げれば本当に悪夢のような画像を作成できますが、スライダーを微妙に使用すると、元の画像を見なければ気付かない程度に人物の顔や表情を変えることができます。

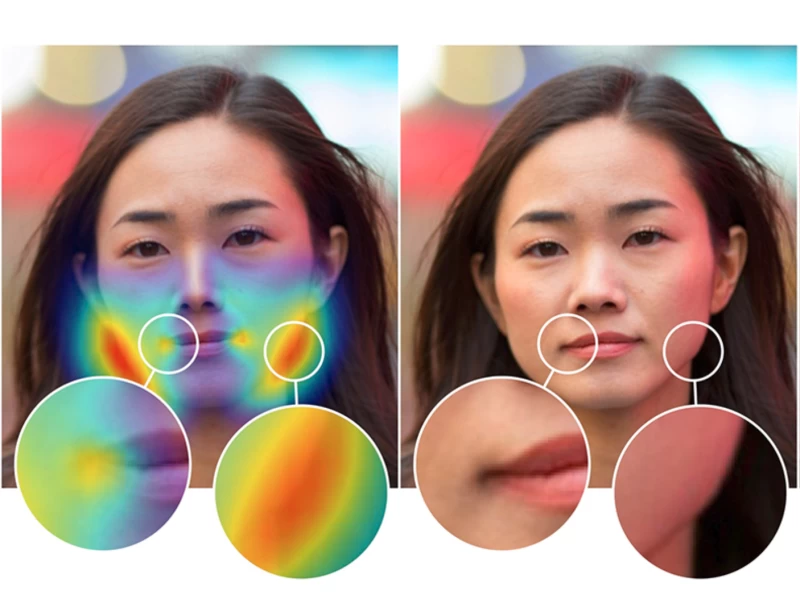

Adobeは研究の中で、ニューラルネットワークと被験者の両方に、修正後の写真と元の写真をペアにして提示しました。人間が修正後の写真を識別できたのは約53%でしたが、ニューラルネットワークは約99%の精度を達成したと報告されています。さらに、AIは元のワープ効果による歪みなどの手がかりを組み合わせて、編集を元に戻し、元の写真に近いものを得ることさえできました。

立証責任

このようなツールは有用ですが、検出プロセスが作成に追いつくまでには、まだ長い道のりがあります。カリフォルニア大学バークレー校のコンピュータサイエンス教授、ハニー・ファリド氏は最近、ワシントン・ポスト紙に対し、ディープフェイク動画の検出を目指す研究者は、動画をより本物らしく、見破りにくくする研究に取り組んでいる研究者の数の100倍にも及ばないと述べました。

たとえ技術が追いついたとしても、解決すべき課題は依然として多く、中でもAIの判断を人々に信頼してもらうことは、特にAIが評価するコンテンツが政治的または分断を招く可能性がある場合、なおさら重要です。また、画像の検証に関する古くからの問題もあります。写真や動画がデジタル加工されていないことを証明すると、そのメッセージに過度の信憑性を与えてしまう可能性があります。写真家やビデオグラファーは、どのような情報をどのように提示するかを積極的に選択しているため、デジタル加工を施さなくても視聴者を誤解させる可能性は依然として高いのです。

現時点ではこれらのツールを試す方法がなく、今すぐ自分で試すことはできませんが、Adobeやその他の企業、そして軍もこの種の技術の開発を進めているので、今後さらに情報が増えることが予想されます。また、偽造された画像や動画も増えていくでしょう。