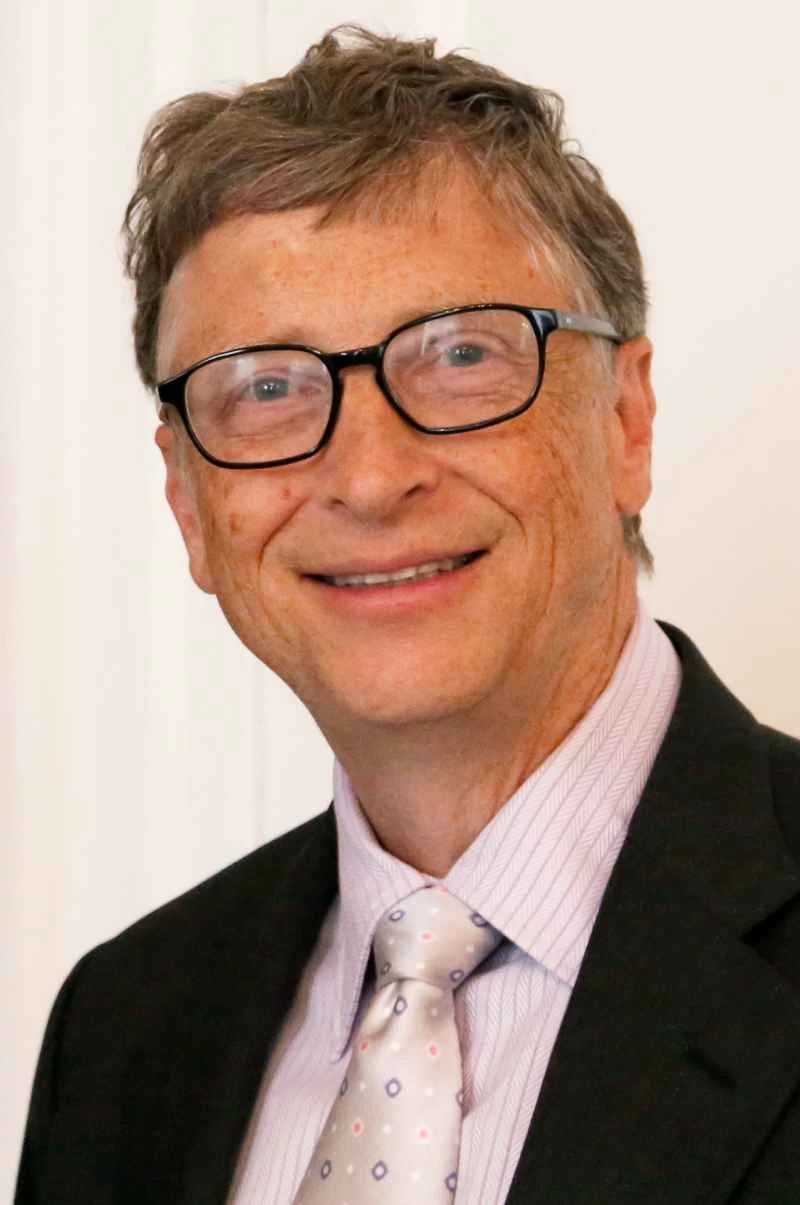

皆様、2015 年の AI パニックにビル ゲイツをお迎えください。

先週水曜日、RedditのAMA(何でも聞いてください)セッションで、beastcoinというユーザーがMicrosoftの創業者に非常に優れた質問をしました。「機械による超知能はどれほどの実存的脅威になると思いますか?また、インターネット上のあらゆる活動にエンドツーエンドの完全暗号化を施すことで、その脅威から私たちを守ることができると思いますか?(例えば、機械が知らない情報が多ければ多いほど良い、など)?」

残念ながら、ゲイツ氏は質問の後半部分には答えず、次のように書いている。

ロボット恐怖症の人々にとって、反人工知能ドリームチームはほぼ完成している。イーロン・マスクとビル・ゲイツは資金と影響力を持ち、伝説の宇宙学者スティーブン・ホーキングは、悪のロボットと捕食性エイリアンの両方への恐怖を広く報道されているが、その比類なき知性を持ち合わせている。彼らに欠けているのは、殺人マシンとの先制攻撃に自らの手を汚す覚悟のある、力強い存在だけだ。

実際、この新生 AI アベンジャーズに本当に必要なのは、さらに突飛なものである。つまり、人工超知能が具体的な脅威である、あるいは真剣な研究優先事項であるという兆候である。

もしかしたら私は間違っているのかもしれない。あるいは、AI研究をめぐる高まるヒステリーに対抗することに固執しすぎて、今日のコードに宿る怪物的な知性の兆候に気付いていないのかもしれない。もしかしたら、ゲイツ、ホーキング、マスクは並外れた頭脳を持つ人物なので、私が知らない何かを知っているのかもしれない。そこで、著名なAI研究者たちが超知能について語ったことを以下に紹介する。

当初、これらの方々にはPopular Science誌に掲載予定の記事のために連絡を取っていましたが、AIを取り巻く状況について改めて考える必要がある時があるとすれば、まさに今です。その精神に基づき、編集や恣意的な引用をほとんど行わず、質問への回答を余すところなく掲載します。そのため、以下の引用は意図的に密集しています。なお、これらの研究者を選んだのは、確証バイアスに陥りやすい過去の意見を並べ立てる「ピーナッツギャラリー」的な手法ではなく、機械学習と深層学習に関する研究実績と専門的経験に基づくものであることをご承知おきください。ニューラルネットワーク、コグニティブコンピューティング、そしてAIシステムが最終的に人間の知能に到達するか、あるいは凌駕するという一般的な概念について議論する際、通常は機械学習と深層学習について言及されます。もしパニックに陥るべき時かどうかを知っている人がいるとすれば、それはこれらの研究者たちです。

「人工超知能は突然、あるいは偶然に生み出されるものではありません。」

AIスタートアップ企業Vicariousの共同創業者ディリープ・ジョージ氏は、スーパーインテリジェンスのリスクについて次のように語る。

Vicariousのこの視点は、同社の学習型AIへの取り組みだけでなく、イーロン・マスク氏がこのスタートアップを自身の舞台裏を覗く機会として位置付けていることからも、意義深いものとなっています。マスク氏はCNBCに対し、Vicariousへの投資について「実際に投資収益を得ようという立場からではなく、純粋に人工知能の動向を見守りたいだけ」だと述べています。また、「大手AI企業は安全性を確保するために多大な努力を払ってきました。彼らは危険性を認識していますが、デジタル超知能を形作り、制御し、悪意のあるものがインターネットに流出するのを防ぐことができると考えています。それはまだ分かりません…」と述べています。

そこで私はVicarious社に、超知能の創造を防ぐためにどのような時間とリソースを費やしているのか尋ねました。Vicarious社のもう一人の共同創設者であるD・スコット・フェニックス氏からの回答は次のとおりです。

Vicariousはスーパーインテリジェンスについては何もしていません。彼らの関心事ではないのです。では、マスク氏が言及しているのはどの企業のことでしょうか?そして、彼の言葉を借りれば、悪質なスーパーインテリジェンスが「インターネットに逃げ込む」ことを真剣に懸念している企業はあるのでしょうか?言い換えれば、悪魔(マスク氏のAIの表現であり、私のものではありません)が実在しないのに、どうやって悪魔のための牢獄を作るのでしょうか?

FacebookのAI研究担当ディレクターであり、ニューヨーク大学データサイエンスセンターの創設ディレクターでもあるヤン・ルカン氏は、企業がAIの暴走を積極的に阻止しているかどうかという質問に対し、次のように答えた。

ルカン氏はまた、超知能を不可避なものとして捉えようとする人々が混乱する主な原因の1つである、知能と自律性の違いについても言及した。

これは極めて重要な区別であり、マスク、ホーキング、そして今やゲイツが煽っているパニックの核心に迫るものです。AIは知覚を持たなくても賢く、創造性を持たなくても有能であり得ます。さらに重要なのは、AIは生物の進化の軌跡をデジタル版で駆け抜け、有益な突然変異が自発的に暴走する超知能を引き起こすまで競争と繁殖を続けるわけではないということです。AIはそういう仕組みではありません。

「近い将来、マウス並みの知能を持つ機械を作れたら驚くだろうが、まだその段階には程遠い」

検索アルゴリズムは人間よりも速く検索結果を提示しますが、突然倫理規定を生み、ポルノの嗜好を非難することはありません。人間レベルの汎用知能が突然、奇跡的に自ら解くというパズルを想像できるのは、SF作家か、コンピューター科学者ではない人だけです。もしあなたが世俗的な奇跡を一つ信じるなら、自己組織化型超知能という形でもう一つ奇跡を加えてみてはいかがでしょうか?

ルカン氏はマスク氏を擁護し、AIを核兵器と比較した同氏のコメントは「誇張されているだけでなく、誤解されている」と述べた。

このトピックについて最も発言力のある研究者は、最後の回答で言及された人物です。ヨシュア・ベンジオ氏はモントリオール大学機械学習研究所の所長であり、ルカン氏と共にディープラーニングという分野における先駆的な研究者の一人として広く知られています。AI研究が本質的に危険であるかどうかという問いに対する彼の回答は次のとおりです。

私はまた、超知能は必然なのかと尋ねました。ベンジオ氏の答えはこうでした。

また、同じくマスク氏が提唱した、AIは「潜在的に核兵器よりも危険」であり、慎重に扱うべきという考えについては、ベンジオ氏は未知の未来を否定することなく、現状について語った。

これらの回答に共通するのは時間だ。AI研究者(繰り返しになるが、真のAI研究者、つまり、そもそもうまく機能するシステムを作ること、ましてやうまく機能しすぎることなど考えもしない人々)と話をすると、彼らは現在も将来も、超知能が忍び寄ることを心配していない。マスク氏が語りたがっているような不気味な話とは裏腹に、AI研究者たちは慌ててファイアウォールで保護された召喚室や自爆カウントダウン装置を設置しているわけではない。せいぜい、これらの科学者たちは超知能という問題について熟考している程度だ。これは二者択一の問題ではない。パニックと警戒の違いは程度の問題だ。AI研究の現状を最もよく知る人々が超知能を優先度の低い研究テーマと見ているのであれば、なぜ私たちは誰か(そう、ビル・ゲイツでさえ)の根拠のない無作為な発言に惑わされて、その考えを変えようとするのだろうか?