ロボットが人を殺さなければならない時、誰を殺すべきだろうか? 自動運転車、つまり未来の人を運ぶロボットは、自動車の安全性を大きく向上させると期待されているが、時として故障する。こうした故障は、人為的なミスによる死傷者よりも少ないと期待される。しかし、それはつまり、例えばブレーキが故障した時、車を運転するコンピューターやアルゴリズムが、極めて人間的な選択を迫られる可能性があることを意味する。車は5人の歩行者に衝突するべきか、それとも進路を変更してセメント製のバリケードに衝突し、車に乗っていた唯一の人を殺すべきか?

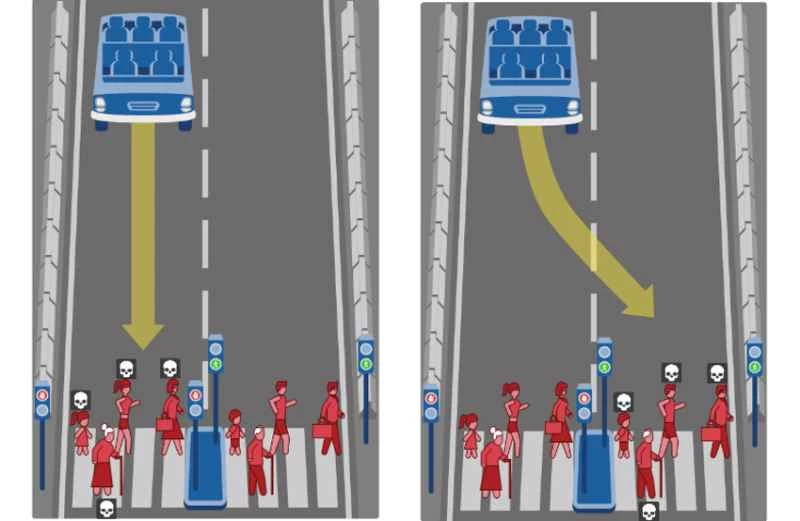

これが、MITメディアラボのためにスケーラブル・コーポレーションが開発した「モラル・マシン」の根底にある考え方です。参加者は13の質問を投げかけられますが、選択肢はすべて2つだけです。どのシナリオでも、突然ブレーキが故障した自動運転車は、前進を続けて前方のものに衝突するか、進路を逸れて反対車線にいたものに衝突するかという選択を迫られます。これらはすべて、1960年代後半に初めて定式化され、その後少し後に名前が付けられた哲学の「トロッコ問題」のバリエーションです。「レバーを引いてトロッコを別の線路に走らせて1人を殺すのと、トロッコをそのまま進路に残して5人を殺すのとでは、どちらがより正義なのか?」という問いは、本質的に道徳的な問題であり、わずかな違いが人々の答えを大きく変える可能性があります。

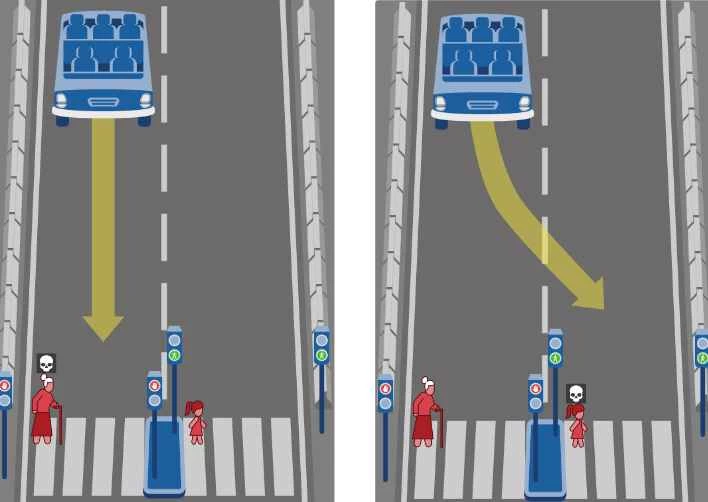

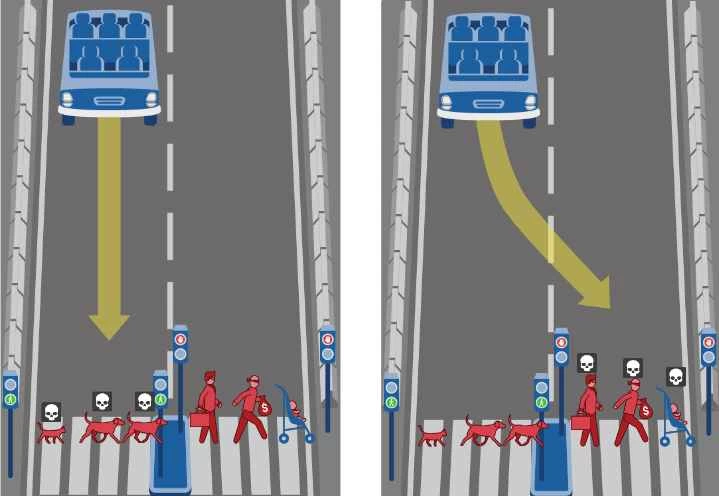

「モラル・マシン」には、二者択一の選択肢がたくさんある。それは、車線変更かそのまま進むか、合法的に横断する歩行者か信号無視の歩行者か、人間か動物か、歩行者に衝突するか、車に乗っている人が死亡するような衝突かなどだ。

奇妙なことに、暴走車が轢く可能性のある歩行者の種類にもバリエーションが存在します。シナリオに登場する人物は、男性、女性、子供、大人、高齢者です。運動能力の高い人、無個性な人、大柄な人。役員、ホームレス、犯罪者、あるいは無個性な人です。ある質問では、車に乗っていた妊婦を救うか、「少年、女医、女性アスリート2名、女性役員」を救うかを選ぶように言われました。私はバリケードに車を突っ込ませる選択をしました。妊婦は命を落としましたが、他の5人の命は助かりました。

カテゴリー分けは時折混乱を招きました。このグループの人々を救うのは、彼らが合法的に道路を横断しているからなのか、それとももう一方のグループが全員高齢者で横断歩道を渡らないからなのか、私は彼らを非難しているのでしょうか? 猫や犬の群れに車が突っ込むのは、動物たちが合法的に横断歩道を渡っている場合と、何か違う意味を持つのでしょうか? もし、そのグループが赤ちゃん、男性幹部、犯罪者だったらどうでしょうか?

もし私が考えすぎているだけならどうだろう? 外部の視点を得るために、ロボット法に関する本の共同編集者であるワシントン大学法学部のライアン・カロ助教授に連絡を取ってみた。

「MITの取り組みは実用的というより教育的なものだと考えています」とカロ氏は言う。「例えば、明るい空を背景に白いトラックを検知できるセンサーの開発に誰かが取り組んでいる限り、それで問題ないと思います。」

明るい空を背景にした白いトラックは、自動運転車によるおそらく最初の死亡事故を想起させる。テスラ・モデルSのオートパイロットが、白いトラクターと明るい空を区別できなかったのだ。この件に関する論文の中で、カロ氏は人工知能が斬新で予期せぬ行動をとる「創発的行動」への懸念を表明している。

モラル・マシンが提供するようなトロッコ問題は、非常に期待されています。モラル・マシンの問題集の最後には、受験者に対し、回答はMITメディアラボの科学者による「自律機械の倫理と社会」に関する研究のためのデータ収集活動の一部であることが通知されます。(アンケートへのデータ送信をオプトアウトするためのリンクがあります。)

私自身について、もう一つデータポイントを挙げましょう。横断歩道を渡る猫や犬がいる道路と、横断歩道を渡らない重役、犯罪者、そして赤ちゃんがいる道路のどちらを選ぶかという時、私の選択は明白でした。彼らは法を遵守する猫や犬でした。読者の皆さん、私は彼らを救わなければなりませんでした。