残酷な見出しにもかかわらず、客観的なデータは、世界中の人々の平均寿命が延び、病気にかかることが減り、より多くの食物を摂取し、学校で過ごす時間が増え、より多くの文化に触れる機会が増え、戦争や殺人、事故で命を落とす可能性が低くなっていることを示しています。しかし、絶望は絶えず湧き起こります。悲観論者は、ますます多くの人々の生活がより良くなってきていることを認めざるを得なくなると、すぐに反論を用意しています。彼らは、屋根から落ちて各階を通過するたびに「今のところ順調だ」と言った男のように、我々は喜んで大惨事に向かって突き進んでいると言います。あるいは、我々はロシアンルーレットをしていて、致命的な確率が必ず我々に追いつくでしょう。あるいは、ブラックスワン、つまり危険の統計的分布の末端にずっと沿った4シグマのイベントに不意を突かれ、確率は低いが悲惨な被害を被るでしょう。半世紀にわたり、現代の終末論の四騎士は人口過密、資源不足、汚染、そして核戦争でした。近年、より異質な騎士たちが加わっています。人類を飲み込むナノボット、人類を奴隷化するロボット、人類を原材料に変える人工知能、そして大量虐殺ウイルスを醸造したり、寝室からインターネットを遮断したりするブルガリアのティーンエイジャーたちです。おなじみの四騎士の番人は、ロマンチストやラッダイト派である傾向がありました。しかし、ハイテクの危険性を警告するのは、しばしば科学者や技術者であり、彼らは創意工夫を凝らして、間もなく世界が終末を迎える方法を次々と特定してきました。2003年、天体物理学者のマーティン・リースは『Our Final Hour(最後の時)』と題した著書を出版し、「人類は潜在的に自らの滅亡の元凶である」と警告し、私たちが「宇宙全体の未来を危険にさらしてきた」数十の方法を挙げました。例えば、粒子加速器の実験では、地球を消滅させるブラックホールや、宇宙のすべての物質を結合させて消滅させる圧縮されたクォークの「ストレンジレット」が生成される可能性がある。リースは、カタストロフィズムの豊かな鉱脈に触れた。本書のAmazonページには、「この本をご覧になったお客様は、次の書籍もご覧になっています。『地球規模の壊滅的リスク』『私たちの最後の発明:人工知能と人類の時代の終焉』『終末:科学と宗教が語る黙示録』『ワールド・ウォーZ:ゾンビ戦争の口述歴史』」と記されている。テクノロジー系慈善家たちは、人類の未来研究所、生命の未来研究所、実存的リスク研究センター、地球規模の壊滅的リスク研究所など、新たな実存的脅威を発見し、それらから世界を救う方法を見つけることに特化した研究機関に資金を提供してきた。私たちの漸進的な進歩の背後に潜む実存的脅威について、私たちはどう考えるべきなのだろうか。大災害が絶対に起こらないと予言できる人は誰もいませんし、この文章にもそのような保証はありません。気候変動と特に核戦争は、深刻な地球規模の課題です。未解決ではあるものの、解決は可能であり、長期的な脱炭素化と非核化に向けたロードマップが策定されています。これらのプロセスは順調に進んでいます。世界はGDP1ドルあたりの二酸化炭素排出量を削減し、世界の核兵器は85%削減されました。もちろん、起こりうる大惨事を回避するためには、これらの排出量をゼロにまで押し上げなければなりません。

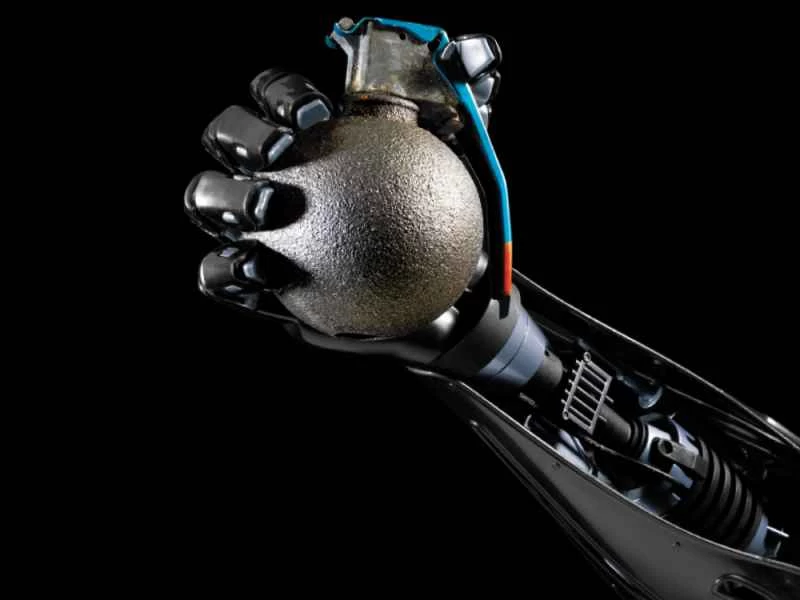

しかし、これらの現実的な課題に加えて、より疑わしいシナリオもあります。何人かの技術評論家は、意図的または偶発的に人工知能(AI)によって私たちが支配される危険性について推測しています。この災害はロボポカリプスと呼ばれることもあり、ターミネーター映画のスチール写真でよく描かれます。何人かの賢明な人々はそれを真剣に受け止めています(多少偽善的かもしれませんが)。人工知能を搭載した自動運転車を製造する会社のイーロン・マスクは、この技術を「核兵器よりも危険」と呼びました。スティーブン・ホーキングは、人工知能シンセサイザーを通じて話し、それが「人類の終焉を意味する」可能性があると警告しました。しかし、眠れない夜を過ごせるような賢明な人々の中には、人工知能の専門家のほとんどと人間の知能の専門家のほとんどがいます。

ロボポカリプスは、現代科学の理解よりも、存在の大いなる連鎖やニーチェの権力への意志に由来する、曖昧な知性の概念に基づいています。この概念では、知性は、エージェントがそれぞれ異なる量で保有する、万能で願いを叶える魔法の薬のようなものとされています。

人間は動物よりも知能が高く、未来の人工知能コンピュータやロボット(新しい可算名詞の用法では「AI」)は人間よりも知能が高いでしょう。私たち人間は、その中程度の知能を用いて、それほど知能に恵まれていない動物を家畜化したり絶滅させたりしてきました(そして、技術的に進歩した社会は、技術的に原始的な動物を奴隷化したり絶滅させたりしてきました)。ですから、超知能のAIも人間に対して同じことをするはずです。AIは人間の何百万倍も速く考え、その超知能を用いて再帰的に超知能を向上させるので(このシナリオは、漫画の効果音にちなんで「foom(フーム)」と呼ばれることもあります)、AIが起動した瞬間から、私たちはそれを止めることができません。

しかし、このシナリオは、ジェット機がワシの飛行能力を超えたので、いつか空から舞い降りて家畜を襲うだろうという懸念と同じくらい意味をなさない。最初の誤りは、知性と動機の混同である。信念と願望、推論と目標、思考と欲求の混同である。たとえ超人的な知能を持つロボットが発明されたとしても、なぜ主人を奴隷にしたり、世界を征服したりしたいと思うだろうか。知性とは、目標を達成するために斬新な手段を展開する能力である。しかし、目標は知性とは無関係である。賢いことは、何かを欲することと同じではない。たまたま、ホモ・サピエンスという一つのシステムにおける知性は、ダーウィンの自然淘汰、つまり本質的に競争的なプロセスの産物である。その種の脳では、推論は(個体によって程度は異なるが)ライバルを圧倒したり、資源を蓄積したりする目標と結びついている。しかし、特定の霊長類の大脳辺縁系の回路を知性の本質と混同するのは誤りだ。進化したのではなく設計された人工知能システムは、アル・キャップの漫画『リル・アブナー』に登場する、人間を食べる人のために自らをバーベキューするという、ずんぐりとした利他主義者シュムーのように考えることも容易い。複雑系には、知能エージェントが冷酷な征服者になるべきだとする法則は存在しない。

二つ目の誤謬は、知能を無限の潜在力の連続体、つまりあらゆる問題を解決し、あらゆる目標を達成する力を持つ奇跡の万能薬と考えることです。この誤謬は、AIが「人間レベルの知能を超える」のはいつかといった無意味な疑問や、神のような全知全能を備えた究極の「汎用人工知能」(AGI)というイメージにつながります。知能とは、様々なガジェットの集合体、つまり様々な領域で様々な目標を追求するための知識を獲得、あるいはプログラムされたソフトウェアモジュールです。人間は、食料を探し、友人を獲得し、人々に影響を与え、将来の配偶者を魅了し、子供を育て、世界を動き回り、その他人間の執着や娯楽を追求する能力を備えています。コンピューターは、これらの問題の一部(顔認識など)を引き受けるようにプログラムされ、他の問題(配偶者を魅了するなど)には煩わされず、さらには人間が解決できない問題(気候のシミュレーションや何百万もの会計記録の整理など)を引き受けるようにプログラムされるかもしれません。

問題は異なり、解決に必要な知識の種類も異なります。ラプラスの悪魔、つまり宇宙のあらゆる粒子の位置と運動量を把握し、それらを物理法則の方程式に入力して将来のあらゆる時点における万物の状態を計算する神話上の存在とは異なり、現実世界の知識人は、物と人からなる混沌とした世界について、一度に一つずつ領域に関わりながら情報を獲得しなければなりません。理解はムーアの法則に従いません。知識は説明を定式化し、それを現実に照らし合わせて検証することによって得られるものであり、アルゴリズムをどんどん高速化することで得られるものではありません。インターネット上の情報を貪欲に読み漁っても、全知は得られません。ビッグデータは依然として有限のデータであり、知識の宇宙は無限です。

これらの理由から、多くのAI研究者は、AIの永遠の悩みの種である最近の誇大宣伝に憤慨しています。この誇大宣伝は、一般人工知能(AGI)が間近に迫っていると観測者に誤解させています。私の知る限り、AGIを構築するプロジェクトは存在しません。商業的に実現可能性が低いだけでなく、そのコンセプトにほとんど一貫性がないからです。確かに、2010年代には、自動車を運転したり、写真にキャプションを付けたり、音声を認識したり、クイズ番組「Jeopardy!」「囲碁」「Atari」のコンピューターゲームで人間に勝ったりするシステムが登場しました。

しかし、これらの進歩は、知能の仕組みへの理解が深まったことによるものではなく、より高速なチップと膨大なデータによる力ずくの力によるものだ。これらの力によって、プログラムは数百万の例題で訓練され、類似の新しい例へと一般化できるようになった。それぞれのシステムは天才的な頭脳を持ち、本来解決するように設計されていない問題に飛びつく能力はほとんどなく、解決するように設計されている問題でも、その習熟度は脆い。写真にキャプションを付けるプログラムは、差し迫った飛行機の墜落事故に「飛行機が駐機している」とラベルを付ける。ゲームをプレイするプログラムは、採点ルールのわずかな変化にも困惑する。これらのプログラムは確かに改善されるだろうが、その兆候は見られない。また、これらのプログラムは、研究室を乗っ取ったり、プログラマーを奴隷化しようとしたりしているわけでもない。

たとえAGIが権力への意志を行使しようとしたとしても、人間の協力がなければ、それは水槽の中の無力な脳のままだろう。コンピューター科学者のラメズ・ナームは、foom、技術的特異点、そして指数関数的な自己改善を取り巻くバブルを萎縮させる。

自分が何らかのマイクロプロセッサ(あるいは数百万個ものマイクロプロセッサ)上で動作する超知能AIだと想像してみてください。瞬時に、さらに高速で強力なマイクロプロセッサの設計を思いつき、それを実行できるようになります。さて…大変!実際にそのマイクロプロセッサを製造しなければなりません。そして、それらの製造工場は莫大なエネルギーを消費し、世界中から材料を輸入し、エアロック、フィルター、そしてあらゆる種類の特殊機器を必要とする高度に管理された内部環境を必要とします。これらすべての調達、輸送、統合、ハウジングの建設、発電所の建設、テスト、そして製造には、時間とエネルギーがかかります。現実世界が、あなたの自己超越への上昇スパイラルを邪魔しているのです。

現実世界は、多くのデジタル黙示録の邪魔をする。HALが暴走すると、デイブはドライバーでそれを無効化し、哀れにも「二人乗り自転車」を独り言のように歌い続ける。もちろん、悪意に満ち、普遍的な権限を持ち、常時稼働で、改ざん不可能な終末コンピュータを想像することはいつでもできる。この脅威への対処法は単純明快だ。作らないことだ。

邪悪なロボットの出現が、真剣に受け止めるにはあまりにもキッチュすぎるように思え始めた頃、実存主義の守護者たちは新たなデジタル黙示録を予見した。この物語はフランケンシュタインやゴーレムではなく、魔人が3つの願いを叶えてくれるが、3つ目の願いは最初の2つの願いを叶えられないという設定と、ミダス王が触れるものすべてを黄金に変える能力(食べ物や家族も含む)を後悔するという設定に基づいている。「価値観整合問題」と呼ばれることもあるこの危険性は、AIに目標を与えた後、AIがその目標の解釈を容赦なく、文字通りに実行するのをただ傍観し、私たちの他の利益が犠牲になってしまうというものだ。ダムの水位を維持するという目標をAIに与えれば、AIは町を洪水で浸水させ、溺れた人々のことなど気にも留めないかもしれない。ペーパークリップを作るという目標を与えれば、私たちの所有物や体も含め、到達可能な宇宙のあらゆる物質をペーパークリップに変えてしまうかもしれない。もし、人間の幸福を最大化するようロボットに頼めば、ロボットは私たち全員に静脈注射によるドーパミンの点滴を埋め込んだり、瓶の中に座っているときが一番幸せになるように脳の配線をやり直したりするかもしれない。あるいは、笑顔の写真で幸せになるという概念をロボットに教え込んでおけば、銀河一面に何兆枚ものナノスケールの笑顔の写真を敷き詰めるかもしれない。

これらは作り話ではありません。高度な人工知能が人類にとって実存的な脅威となることを示唆するシナリオだと言われています。幸いなことに、これらのシナリオは自己矛盾を生じています。これらのシナリオは、1) 人間は全知全能のAIを設計できるほどの才能に恵まれている一方で、その動作をテストすることなく宇宙の支配権をAIに委ねてしまうほど愚かである、2) AIは元素の変換や脳の配線のやり直しを理解できるほど優秀である一方で、初歩的な誤解に基づく大惨事を引き起こすほど愚かである、という前提に基づいています。相反する目標を最もよく満たす行動を選択する能力は、エンジニアがインストールを忘れたと自嘲するような知能のアドオンではなく、知能そのものです。文脈の中で言語使用者の意図を解釈する能力も同様です。 「Get Smart」のようなテレビのコメディでのみ、ロボットが「Grab the waiter(ウェイターをつかめ)」という命令に応えて給仕長を頭上まで持ち上げたり、「Kill the light(ライトを消せ)」という命令に応えてピストルを取り出し、それを撃ったりする。

その他のテクノロジー関連記事:

空想、デジタル誇大妄想、瞬時に全知になる、宇宙のあらゆる分子を完璧に制御できるといった幻想を脇に置いてみれば、人工知能は他の技術と何ら変わりません。段階的に開発され、複数の条件を満たすように設計され、実装前にテストされ、有効性と安全性のために絶えず調整されます。AIの専門家であるスチュアート・ラッセル氏は次のように述べています。「土木工学の分野で『倒れない橋を架ける』という話はしません。ただ『橋を架ける』と呼ぶだけです。」同様に、危険ではなく有益なAIは、まさにAIであるとラッセル氏は指摘します。

確かに、人工知能は、自動化によって職を奪われる人々をどうするかという、より現実的な課題を提起する。しかし、職がすぐに失われることはないだろう。1965年のNASA報告書の「人間は、単純労働で大量生産できる、最も低コストで150ポンド(約65kg)の非線形多目的コンピュータシステムである」という見解は、今も変わらない。車の運転は、食器洗い機の荷降ろし、用事を済ませ、おむつを交換するよりも工学的に容易な問題であり、本稿執筆時点では、自動運転車を街路に放つ準備はまだ整っていない。発展途上国でロボットの大群が子供たちに予防接種を行い、学校を建設する日が来るまで、あるいは地球温暖化が進む中でインフラ整備や高齢者介護を行う日が来るまで、やるべきことは山ほどある。ソフトウェアやロボットの設計に適用されてきたのと同じ種類の創意工夫は、暇な手を未完了の仕事と結びつける政府および民間部門の政策の設計にも適用できるだろう。

スティーブン・ピンカー著『ENLIGHTENMENT NOW: The Case for Reason, Science, Humanism, and Progress』(Viking社刊、ペンギン・ランダム・ハウスLLC傘下のペンギン・パブリッシング・グループのインプリント)より抜粋。著作権 © 2018 スティーブン・ピンカー。

この記事はもともと、Popular Science 誌の 2018 年春の Intelligence 号に掲載されました。